GA4のBigQueryエクスポート設計|データ活用の起点

GA4のBigQueryエクスポート設計|データ活用の起点

BigQueryとGA4の連携は、Google Cloud Platformで1日1回の自動エクスポートを設定するだけで開始できる。ただし、月間データ量が1TB超の場合は月額6万円以上のクエリ費用が発生するため、事前にデータ量とクエリ頻度の見積もりが必要だ。

GA4の標準レポートでは表現しきれない詳細なユーザー行動分析や、広告配信データとの統合が可能になる。ECサイトであれば購入パスの詳細分析、メディアサイトであればエンゲージメント深度の可視化といった、ビジネス成果に直結するインサイトを抽出できる。

BigQueryとGA4連携の基本仕組み

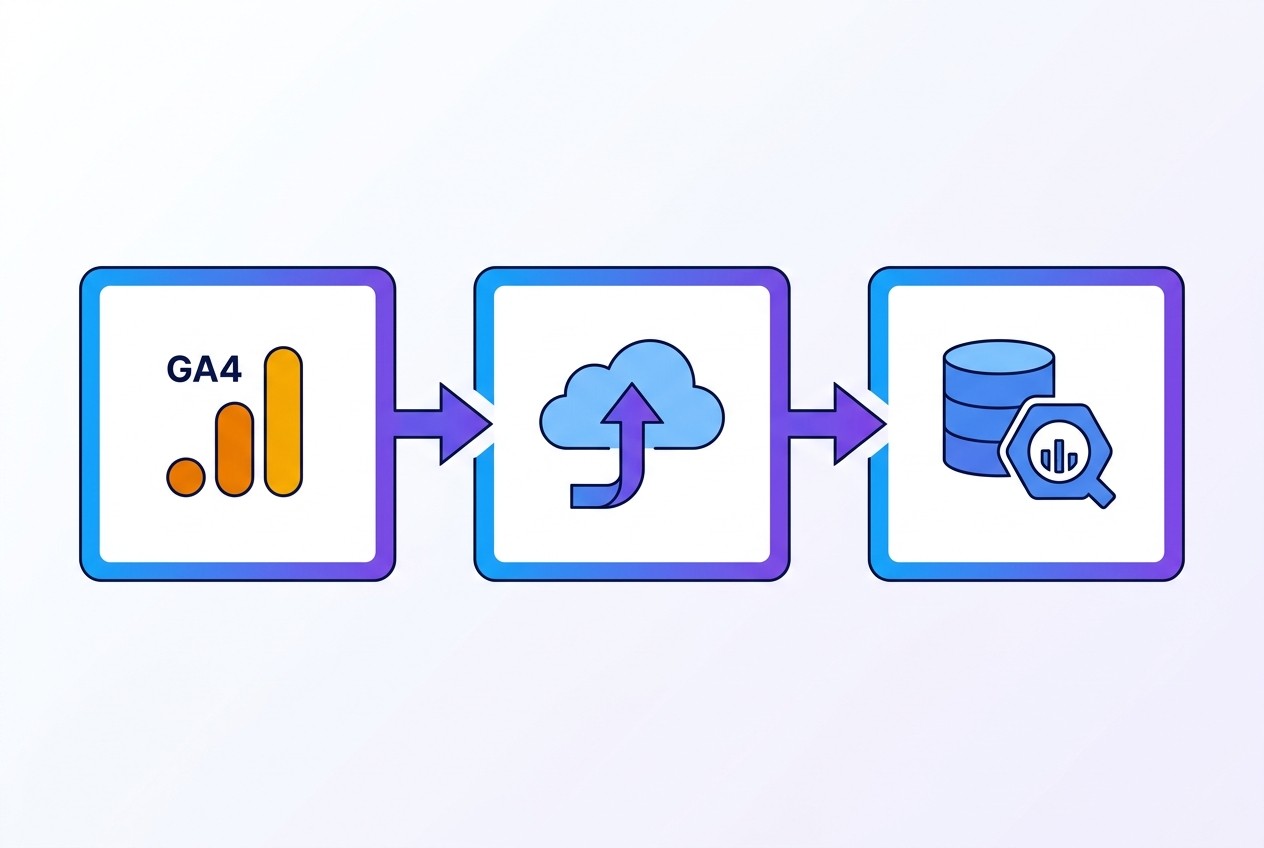

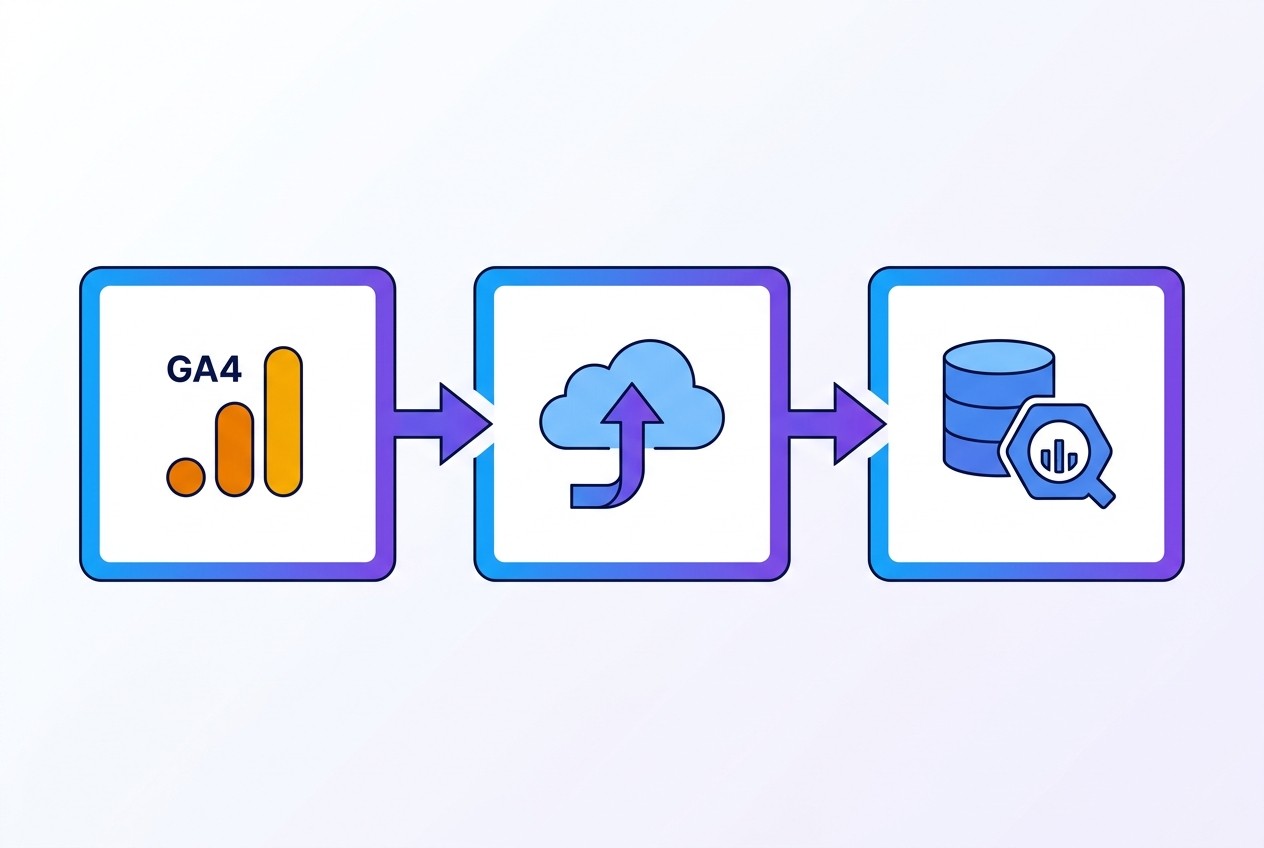

BigQueryとGA4連携は、GA4で収集したイベントデータを毎日UTCの14時頃にBigQueryのデータセットへ自動エクスポートする仕組みだ。

従来のUniversal Analyticsでは不可能だった生データレベルでのアクセスが可能になり、SQLクエリで自由度の高い分析ができる。GA4の標準レポートが集約済みデータを表示するのに対し、BigQueryでは個別のユーザーセッション・イベント単位まで掘り下げられる。

データエクスポートの範囲と制限

エクスポート対象:すべてのイベントデータ、カスタムディメンション、eコマースデータ

データ保持期間:BigQuery側では無制限(GA4は最大14ヶ月)

エクスポート頻度:1日1回(リアルタイムエクスポートは有料版のみ)

データ形式:入れ子構造のJSONフォーマット(RECORD型・REPEATED型を多用)

連携によって実現できる分析

分析カテゴリ | GA4標準レポート | BigQuery連携 |

|---|---|---|

ユーザー行動分析 | 定型の行動フロー | 任意の条件でのパス分析・セグメント比較 |

コンバージョン分析 | アトリビューションモデル4種類 | カスタムアトリビューション・接触点分析 |

データ統合 | GA4データのみ | 広告・CRM・在庫データとの結合 |

期間制限 | 最大14ヶ月 | 無制限(過去データとの比較可能) |

Google Cloud の2024年利用実態調査によると、GA4とBigQueryを連携する企業の78%が「意思決定スピードが2倍以上向上した」と回答している。特に月間PV100万超のメディア企業では、カスタムセグメント分析による広告最適化で、平均CPAが23%改善したという結果が出ている。

GA4で収集したイベントデータが毎日自動的にBigQueryへエクスポートされ、SQLクエリによる高度な分析が可能になる。データは入れ子構造で格納されるため、UNNESTオペレータを使った展開が必要。

BigQuery連携の設定手順

BigQuery連携の設定は、GA4管理画面からGoogle Cloud ProjectとのリンクでBigQueryエクスポートを有効化する手順となる。設定完了後、翌日からデータエクスポートが開始される。

事前準備:Google Cloud Projectの作成

Google Cloud Consoleでプロジェクトを新規作成

BigQuery APIを有効化(APIライブラリから検索・有効化)

課金アカウントを設定(無料枠でも連携は可能だが、本格運用には有料プランが必要)

IAM権限でGA4サービスアカウントにBigQuery管理者権限を付与

GA4側でのエクスポート設定

GA4管理画面 → 「管理」→「BigQueryリンク」

「リンクを作成」→ Google Cloud Projectを選択

データセット名を設定(推奨:analytics_プロパティID)

エクスポート設定の選択:

毎日のエクスポート:標準(無料)

ストリーミングエクスポート:リアルタイム(有料)

「作成」をクリックして設定完了

エクスポート開始の確認方法

設定完了後24-48時間以内に、BigQuery内に以下のテーブルが自動作成される:

events_YYYYMMDD:日別のイベントデータテーブルevents_intraday_YYYYMMDD:当日分の中間テーブル(毎日削除・更新)

テーブル作成が確認できれば、エクスポート設定は正常に完了している。初回エクスポートは設定日の翌日のデータから開始される点に注意が必要だ。

あわせて読みたい

GA4イベントの設計|data layer連携と推奨イベントの設定手順

BigQuery連携を最大限活用するために、事前にGA4イベント設計を整備しておく必要があります。カスタムイベントの設定方法と推奨イベントの実装手順を解説。

BigQueryでのGA4データ構造の理解

GA4からエクスポートされるデータは、ユーザー・セッション・イベントの3層構造で格納され、各層に入れ子配列(REPEATED)やレコード(RECORD)が含まれる。

従来のGoogle AnalyticsやAdobe Analyticsのフラットなテーブル構造とは大きく異なるため、SQLクエリで適切にデータを展開する技術が必要となる。特にeコマースデータやカスタムパラメータは深い入れ子になりがちで、UNNESTオペレータの理解が不可欠だ。

主要テーブルスキーマ

カラム名 | データ型 | 説明 | よく使う場面 |

|---|---|---|---|

event_date | STRING | YYYYMMDD形式のイベント日付 | 期間フィルタ・日別集計 |

event_name | STRING | page_view, purchase等のイベント名 | イベント種別でのフィルタ |

user_pseudo_id | STRING | 匿名ユーザーID(クライアントID) | ユーザー単位での集計・分析 |

event_params | RECORD REPEATED | カスタムパラメータの配列 | カスタムディメンション取得 |

ecommerce | RECORD | 購入・カート関連のデータ | 収益分析・商品分析 |

入れ子データの展開方法

event_paramsやecommerceデータを取得するには、UNNESTとWHERE句を組み合わせた展開が必要:

基本的なクエリ例:

よくあるクエリエラーと対処法

エラー1:「Column event_params.value does not exist」

event_paramsは配列のため、UNNESTで展開せずに直接アクセスできない。必ずUNNEST(event_params)で展開してからvalue.string_valueでアクセスする。

エラー2:「Resources exceeded during query execution」

処理データ量が上限を超過している。_TABLE_SUFFIXで日付範囲を絞るか、LIMIT句で処理行数を制限する。月間データ量が100GB超の場合は、パーティション日付での事前絞り込みが必須。

エラー3:「Cannot access field items on a value with type ARRAY」

ecommerce.itemsも配列のため、UNNESTでの展開が必要。WITH句を使ったサブクエリで段階的に展開すると可読性が向上する。

実務で使える分析クエリパターン

BigQueryでGA4データを活用する際は、ビジネス課題に応じたクエリパターンを持っておくことが効率化の鍵となる。汎用的なダッシュボード向けクエリから、特定の施策効果測定まで、実務でよく使われるパターンを習得すべきだ。

コンバージョンパス分析

ユーザーがコンバージョンまでに辿った流入チャネルの組み合わせを分析する。アトリビューション分析やクロスチャネル戦略の立案に活用する:

カスタムファネル分析

特定のページ遷移やイベントシーケンスでのドロップオフ率を測定する。ECサイトなら商品詳細→カート追加→購入完了の各ステップでの離脱要因を特定できる:

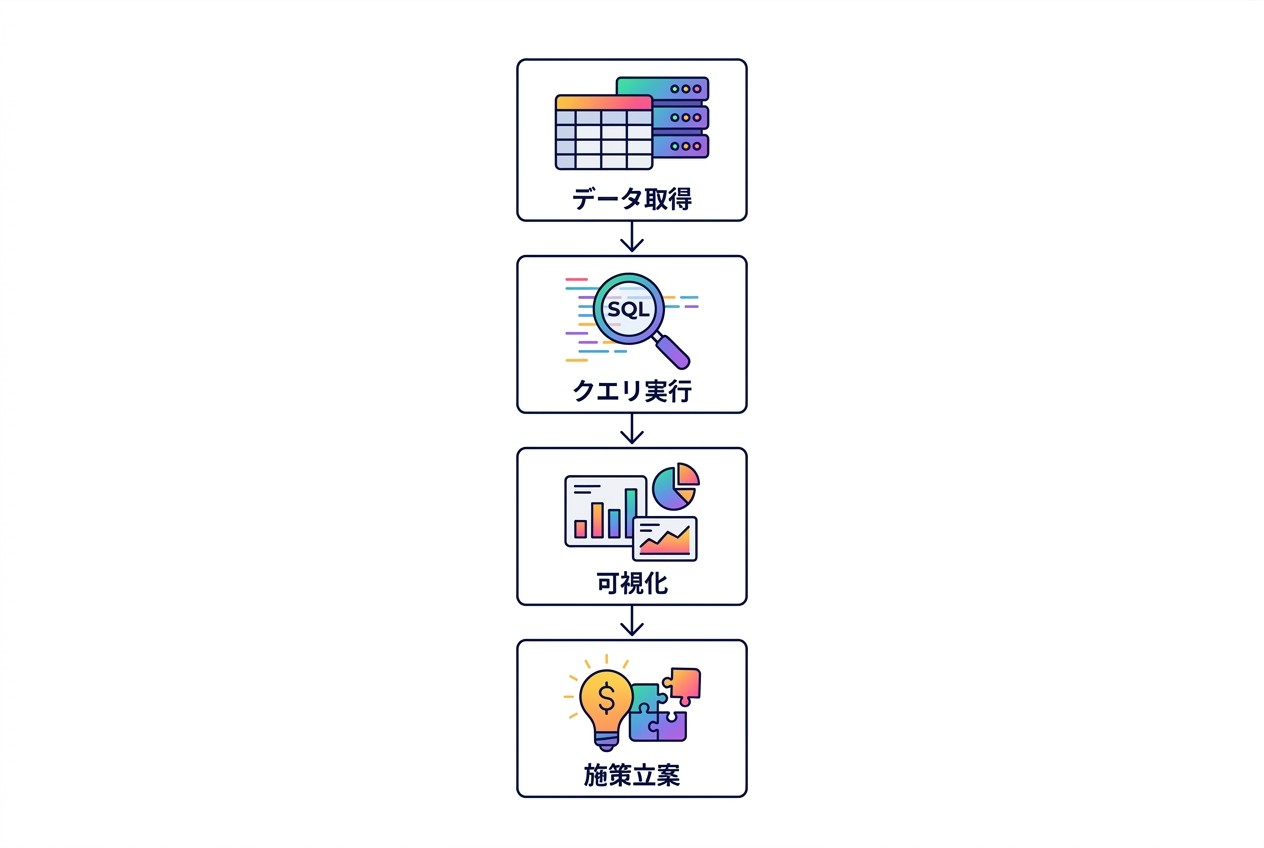

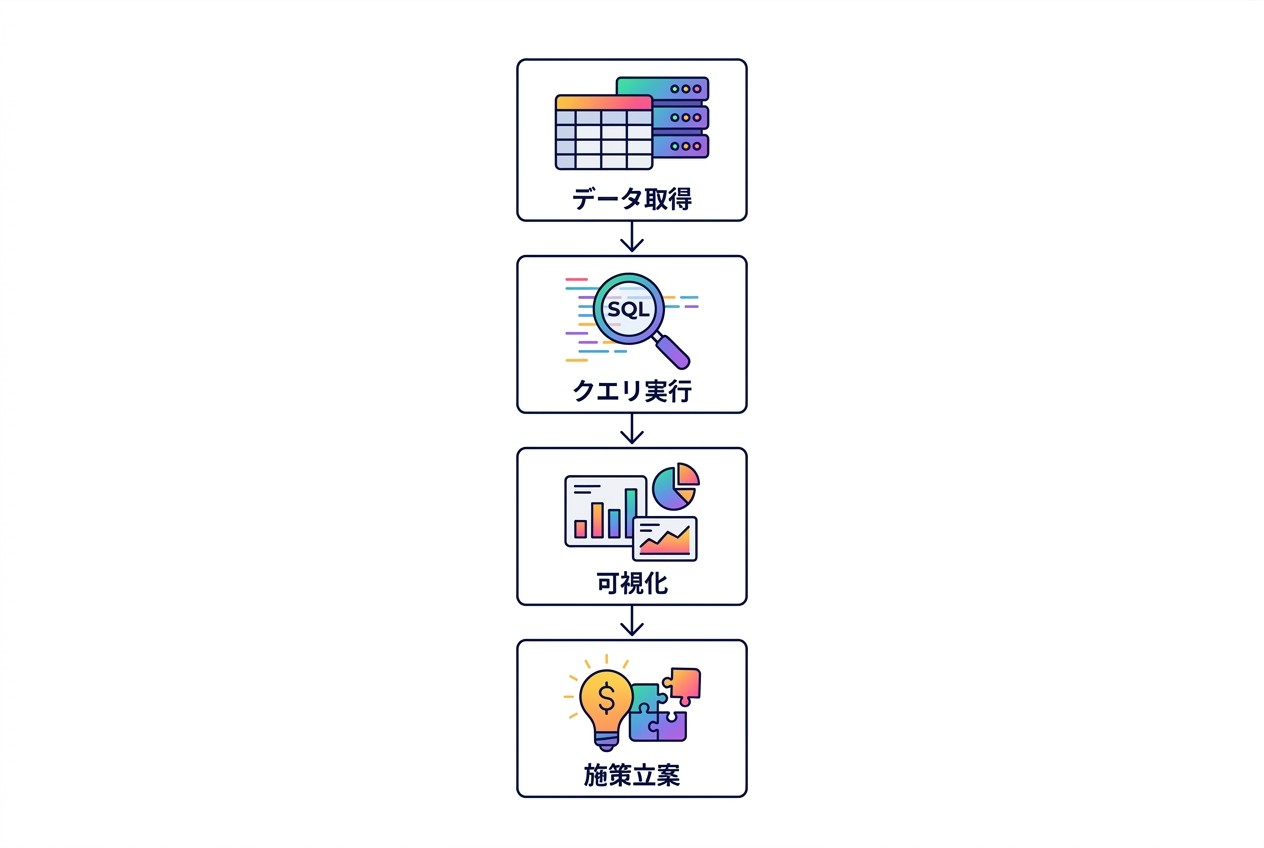

BigQueryでGA4データを分析する際の基本フロー。生データの取得からクエリ実行、可視化、そして具体的な施策立案まで。各ステップで適切なツール選択と検証が重要。

セッション品質スコア算出

滞在時間・PV数・エンゲージメント率を組み合わせた独自の品質指標を作成する。広告運用での入札調整やコンテンツ改善の優先度付けに活用できる:

コスト管理と運用時の注意点

BigQueryの料金体系はクエリで処理するデータ量に基づく従量課金のため、月間データ量とクエリ頻度によっては予想以上のコストが発生する。月額予算を事前に設定し、定期的なコスト監視が必要だ。

料金体系と費用目安

月間PV規模 | 月間データ量(概算) | 月額クエリ費用目安 | 推奨対策 |

|---|---|---|---|

10万PV未満 | 1-5GB | 500円-2,500円 | 無料枠内で運用可能 |

100万PV | 50-100GB | 3,000円-6,000円 | クエリ最適化で半分に削減 |

1,000万PV | 500GB-1TB | 3万円-6万円 | パーティション設計必須 |

1億PV | 5TB以上 | 30万円以上 | 定額プランまたはサンプリング |

アドビの2024年デジタル分析コスト調査によると、BigQuery GA4連携を導入した企業の68%が「初月のクエリ費用が予算の2-3倍になった」と回答している。一方で、適切なクエリ最適化を行った企業では、3ヶ月後にコストを初月の40%まで削減できたという結果も出ている。

コスト削減のクエリ最適化

1. 日付範囲の制限

_TABLE_SUFFIXで処理対象を限定する。全期間クエリは避け、必要最小限の期間に絞る:

2. 必要なカラムのみ選択

SELECT *は全カラムを処理するため高コスト。必要なフィールドだけを明示的に選択する:

3. 事前フィルタの活用

JOINやUNNESTの前に、WHERE句で処理対象データを絞り込む:

よくある運用ミスと対策

ミス1:毎日の全データスキャンクエリ

ダッシュボード更新で毎回全期間データを処理してしまい、月額費用が数十万円に膨らむケース。増分処理や集計テーブルの活用で大幅にコスト削減できる。

ミス2:テストクエリでの大量処理

本番データでクエリテストを行い、意図せず大量データを処理してしまうミス。開発用にサンプルデータセットを作成し、LIMITを必ず付けてテストする。

ミス3:予算アラート未設定

Google Cloud Platformの予算アラート機能を設定せず、想定外のコストに気付くのが月末になるケース。日次・週次でのアラート設定が必須だ。

あわせて読みたい

BigQueryで分析したユーザー行動データを営業活動に活かすためのリード管理設計を解説。分析結果を実際のビジネス成果につなげる運用フローを設計できます。

外部データとの統合活用事例

BigQueryの真価は、GA4データ単体ではなく、広告配信データ・CRMデータ・在庫データなど複数のデータソースを統合した分析にある。顧客のフルジャーニーを可視化し、チャネル横断での最適化が可能になる。

特にECサイトでは、Web行動データと購買履歴・在庫状況を組み合わせることで、売り切れ前の在庫アラートや、購買確度の高いユーザーセグメントでの広告配信最適化などが実現できる。

Google広告データとの統合分析

Google Ads Data Transfer Serviceを使用してGoogle広告の配信データをBigQueryに取り込み、GA4のコンバージョンデータと結合する。これによりLTVを加味した真のROASや、クリエイティブ別の顧客質の違いが見えてくる:

CRMデータとの顧客分析

Cloud StorageまたはCloud SQLに格納したCRMデータと、GA4のuser_idを紐付けることで、オンライン行動と購買履歴を統合した顧客分析が可能になる。リピート購入の予測モデルやカスタマーセグメンテーションに活用できる:

顧客ライフタイムバリュー(LTV)の精密計算:Web行動パターンと実際の購買金額・頻度を組み合わせ

チャーン予測:サイト訪問頻度の変化と過去の離反パターンから早期アラート

クロスセル・アップセル機会の発見:商品カテゴリ別の行動データと購買履歴の相関分析

在庫データとの運用最適化

リアルタイムの在庫情報とGA4の商品別PVデータを組み合わせ、売り切れリスクの高い商品への広告投資を自動調整する仕組みも構築できる。特にシーズン商材やトレンド商品を扱うECサイトで効果的だ。

2024年11月に発表されたZOZOの事例では、BigQueryでGA4データと在庫データを統合し、売り切れ前48時間での広告出稿停止により、無駄な広告費を月額200万円削減したという結果が公表されている。

よくある失敗パターンと回避策

BigQuery GA4連携の導入でよく見られる失敗パターンは、技術的な設定ミスよりも、運用フローやコスト管理の甘さに起因するケースが多い。事前に失敗パターンを把握し、対策を講じることが重要だ。

データガバナンスの欠如

失敗例:複数の部署がそれぞれ独自のクエリを作成し、同じデータを重複処理してコストが膨らむ。また、誤ったクエリで算出された数値がレポートに使われ、意思決定に悪影響を与える。

対策:

標準クエリテンプレートの作成と共有

定期集計テーブルの作成で重複処理を削減

クエリレビューフローの確立(本番実行前の承認プロセス)

BigQueryの権限管理でデータアクセス範囲を制限

リアルタイム性への過度な期待

失敗例:「BigQueryなら最新データがすぐ見られる」と期待したが、GA4の標準エクスポートは1日1回のため、当日の最新データが反映されない。急遽ストリーミングエクスポート(有料)に切り替えて月額コストが5倍になる。

対策:

ビジネス要件でリアルタイム性が本当に必要かを事前検証

GA4標準レポートとBigQuery分析の役割分担を明確化

月額500万PV未満であれば、まず無料の日次エクスポートから開始

リアルタイム分析が必要な指標のみストリーミング対象とする

クエリパフォーマンスの軽視

失敗例:SQLの知識が浅いまま複雑な分析クエリを作成し、実行時間が30分以上かかる非効率なクエリが日次バッチで動き続ける。結果として月額クエリ費用が予算の10倍になる。

対策:

BigQuery特有のベストプラクティス(パーティショニング・クラスタリング)の学習

クエリ実行前の処理データ量見積もりツールの活用

段階的な検証(小さなデータセットでテスト→本番適用)

定期的なクエリレビューとパフォーマンス改善

属人化とスキル格差

失敗例:BigQueryに詳しい担当者1名に依存し、その人が異動・退職した際に分析が完全にストップする。引き継ぎ資料もクエリのコメントも不十分で、復旧に3ヶ月かかる。

対策:

複数名でのスキル習得とナレッジ共有

クエリの可読性向上(コメント・変数名の統一)

分析フローのドキュメント化

外部研修やコンサルティングの活用

BigQuery GA4活用の将来性と発展

GA4とBigQueryの連携は、Google Cloud Platform上でのAI・機械学習サービスとの統合により、さらなる発展が期待されている。BigQuery MLを使った予測分析や、Looker Studioでの高度な可視化など、従来の Web分析の枠を超えた活用が可能だ。

機械学習による予測分析

BigQuery MLを活用すれば、SQLクエリだけでユーザーの離反予測やLTV予測モデルを構築できる。Pythonや専用のML環境を用意せずに、GA4データから直接予測モデルを作成し、マーケティング施策の精度向上に活用できる:

リアルタイム分析基盤の構築

Cloud Pub/SubとDataflowを組み合わせることで、GA4のMeasurement Protocolデータをリアルタイムで処理し、BigQueryに即座に反映する仕組みも構築できる。大規模なECサイトやメディアサイトでは、在庫切れアラートやトラフィック急増対応などに活用されている。

プライバシー規制への対応

GDPR・CCPA・日本の個人情報保護法の改正に伴い、ユーザー同意管理とデータ匿名化がより重要になっている。BigQueryでは、Differential Privacyやk-匿名化などの技術により、プライバシーを保護しながら有用なインサイトを抽出する機能が強化されている。

Googleの2025年戦略発表によると、2026年からはGA4のデータエクスポートでより詳細な同意ステータスが含まれるようになり、ユーザー同意レベルに応じた分析が可能になる予定だ。これにより、コンプライアンス要件を満たしながら、マーケティング効果を最大化する分析基盤が実現できる。

よくある質問

BigQuery GA4連携にかかる初期費用はどの程度ですか?

初期費用は基本的に無料で、Google Cloud Platformアカウント開設とGA4からの設定のみで開始できます。ただし、月間1TB以上のクエリ処理では従量課金が発生し、100万PVサイトで月額3,000-6,000円程度が目安となります。

GA4の生データはBigQueryでどこまで詳細に取得できますか?

ユーザーレベル・セッションレベル・イベントレベルまでの全データを取得でき、カスタムパラメータやeコマースの商品詳細まで含まれます。ただし、Googleシグナルによる集約やサンプリングされたデータは除外され、未加工の生データのみエクスポートされます。

過去データはいつまでさかのぼって分析できますか?

GA4標準では最大14ヶ月の保持期間ですが、BigQueryでは無制限にデータ保持できます。ただし、連携開始前のデータはエクスポートされないため、過去データの分析には連携設定日からの蓄積が必要です。

SQLの知識がない場合、BigQuery活用は難しいでしょうか?

基本的なSQLスキル習得は必要ですが、GA4のデータ構造は特殊なため、一般的なSQL知識だけでは不十分です。UNNESTオペレータや入れ子構造の理解が必要で、実務レベルまで約2-3ヶ月の学習期間を見込んでおくべきです。

BigQueryのクエリ処理が遅い場合の対処法はありますか?

処理速度改善には、日付範囲の制限・不要なカラムの除外・事前フィルタの活用が効果的です。また、頻繁に使用するクエリは集計済みテーブルとして保存し、差分更新することで処理時間を大幅短縮できます。

まとめ

BigQuery GA4連携は、従来のWeb解析の限界を超えた深い顧客理解と精密なマーケティング最適化を可能にする。設定自体は簡単だが、真価を発揮するには適切なデータ構造の理解と、ビジネス課題に応じたクエリ設計が不可欠だ。

成功のポイントは3つある。第一に、月間データ量とクエリ頻度を事前に見積もり、適切なコスト管理を行うこと。第二に、GA4の入れ子構造を理解し、効率的なデータ展開クエリを習得すること。第三に、他の社内データとの統合を視野に入れた分析基盤として設計することだ。

短期的にはGA4標準レポートの補完として活用し、中長期的には予測分析やリアルタイム最適化まで発展させることで、データドリブンマーケティングの実現につなげられる。月間100万PV超のサイトであれば、導入効果は確実にコストを上回る価値を生み出すはずだ。

BigQueryとGA4の連携は、Google Cloud Platformで1日1回の自動エクスポートを設定するだけで開始できる。ただし、月間データ量が1TB超の場合は月額6万円以上のクエリ費用が発生するため、事前にデータ量とクエリ頻度の見積もりが必要だ。

GA4の標準レポートでは表現しきれない詳細なユーザー行動分析や、広告配信データとの統合が可能になる。ECサイトであれば購入パスの詳細分析、メディアサイトであればエンゲージメント深度の可視化といった、ビジネス成果に直結するインサイトを抽出できる。

BigQueryとGA4連携の基本仕組み

BigQueryとGA4連携は、GA4で収集したイベントデータを毎日UTCの14時頃にBigQueryのデータセットへ自動エクスポートする仕組みだ。

従来のUniversal Analyticsでは不可能だった生データレベルでのアクセスが可能になり、SQLクエリで自由度の高い分析ができる。GA4の標準レポートが集約済みデータを表示するのに対し、BigQueryでは個別のユーザーセッション・イベント単位まで掘り下げられる。

データエクスポートの範囲と制限

エクスポート対象:すべてのイベントデータ、カスタムディメンション、eコマースデータ

データ保持期間:BigQuery側では無制限(GA4は最大14ヶ月)

エクスポート頻度:1日1回(リアルタイムエクスポートは有料版のみ)

データ形式:入れ子構造のJSONフォーマット(RECORD型・REPEATED型を多用)

連携によって実現できる分析

分析カテゴリ | GA4標準レポート | BigQuery連携 |

|---|---|---|

ユーザー行動分析 | 定型の行動フロー | 任意の条件でのパス分析・セグメント比較 |

コンバージョン分析 | アトリビューションモデル4種類 | カスタムアトリビューション・接触点分析 |

データ統合 | GA4データのみ | 広告・CRM・在庫データとの結合 |

期間制限 | 最大14ヶ月 | 無制限(過去データとの比較可能) |

Google Cloud の2024年利用実態調査によると、GA4とBigQueryを連携する企業の78%が「意思決定スピードが2倍以上向上した」と回答している。特に月間PV100万超のメディア企業では、カスタムセグメント分析による広告最適化で、平均CPAが23%改善したという結果が出ている。

GA4で収集したイベントデータが毎日自動的にBigQueryへエクスポートされ、SQLクエリによる高度な分析が可能になる。データは入れ子構造で格納されるため、UNNESTオペレータを使った展開が必要。

BigQuery連携の設定手順

BigQuery連携の設定は、GA4管理画面からGoogle Cloud ProjectとのリンクでBigQueryエクスポートを有効化する手順となる。設定完了後、翌日からデータエクスポートが開始される。

事前準備:Google Cloud Projectの作成

Google Cloud Consoleでプロジェクトを新規作成

BigQuery APIを有効化(APIライブラリから検索・有効化)

課金アカウントを設定(無料枠でも連携は可能だが、本格運用には有料プランが必要)

IAM権限でGA4サービスアカウントにBigQuery管理者権限を付与

GA4側でのエクスポート設定

GA4管理画面 → 「管理」→「BigQueryリンク」

「リンクを作成」→ Google Cloud Projectを選択

データセット名を設定(推奨:analytics_プロパティID)

エクスポート設定の選択:

毎日のエクスポート:標準(無料)

ストリーミングエクスポート:リアルタイム(有料)

「作成」をクリックして設定完了

エクスポート開始の確認方法

設定完了後24-48時間以内に、BigQuery内に以下のテーブルが自動作成される:

events_YYYYMMDD:日別のイベントデータテーブルevents_intraday_YYYYMMDD:当日分の中間テーブル(毎日削除・更新)

テーブル作成が確認できれば、エクスポート設定は正常に完了している。初回エクスポートは設定日の翌日のデータから開始される点に注意が必要だ。

あわせて読みたい

GA4イベントの設計|data layer連携と推奨イベントの設定手順

BigQuery連携を最大限活用するために、事前にGA4イベント設計を整備しておく必要があります。カスタムイベントの設定方法と推奨イベントの実装手順を解説。

BigQueryでのGA4データ構造の理解

GA4からエクスポートされるデータは、ユーザー・セッション・イベントの3層構造で格納され、各層に入れ子配列(REPEATED)やレコード(RECORD)が含まれる。

従来のGoogle AnalyticsやAdobe Analyticsのフラットなテーブル構造とは大きく異なるため、SQLクエリで適切にデータを展開する技術が必要となる。特にeコマースデータやカスタムパラメータは深い入れ子になりがちで、UNNESTオペレータの理解が不可欠だ。

主要テーブルスキーマ

カラム名 | データ型 | 説明 | よく使う場面 |

|---|---|---|---|

event_date | STRING | YYYYMMDD形式のイベント日付 | 期間フィルタ・日別集計 |

event_name | STRING | page_view, purchase等のイベント名 | イベント種別でのフィルタ |

user_pseudo_id | STRING | 匿名ユーザーID(クライアントID) | ユーザー単位での集計・分析 |

event_params | RECORD REPEATED | カスタムパラメータの配列 | カスタムディメンション取得 |

ecommerce | RECORD | 購入・カート関連のデータ | 収益分析・商品分析 |

入れ子データの展開方法

event_paramsやecommerceデータを取得するには、UNNESTとWHERE句を組み合わせた展開が必要:

基本的なクエリ例:

よくあるクエリエラーと対処法

エラー1:「Column event_params.value does not exist」

event_paramsは配列のため、UNNESTで展開せずに直接アクセスできない。必ずUNNEST(event_params)で展開してからvalue.string_valueでアクセスする。

エラー2:「Resources exceeded during query execution」

処理データ量が上限を超過している。_TABLE_SUFFIXで日付範囲を絞るか、LIMIT句で処理行数を制限する。月間データ量が100GB超の場合は、パーティション日付での事前絞り込みが必須。

エラー3:「Cannot access field items on a value with type ARRAY」

ecommerce.itemsも配列のため、UNNESTでの展開が必要。WITH句を使ったサブクエリで段階的に展開すると可読性が向上する。

実務で使える分析クエリパターン

BigQueryでGA4データを活用する際は、ビジネス課題に応じたクエリパターンを持っておくことが効率化の鍵となる。汎用的なダッシュボード向けクエリから、特定の施策効果測定まで、実務でよく使われるパターンを習得すべきだ。

コンバージョンパス分析

ユーザーがコンバージョンまでに辿った流入チャネルの組み合わせを分析する。アトリビューション分析やクロスチャネル戦略の立案に活用する:

カスタムファネル分析

特定のページ遷移やイベントシーケンスでのドロップオフ率を測定する。ECサイトなら商品詳細→カート追加→購入完了の各ステップでの離脱要因を特定できる:

BigQueryでGA4データを分析する際の基本フロー。生データの取得からクエリ実行、可視化、そして具体的な施策立案まで。各ステップで適切なツール選択と検証が重要。

セッション品質スコア算出

滞在時間・PV数・エンゲージメント率を組み合わせた独自の品質指標を作成する。広告運用での入札調整やコンテンツ改善の優先度付けに活用できる:

コスト管理と運用時の注意点

BigQueryの料金体系はクエリで処理するデータ量に基づく従量課金のため、月間データ量とクエリ頻度によっては予想以上のコストが発生する。月額予算を事前に設定し、定期的なコスト監視が必要だ。

料金体系と費用目安

月間PV規模 | 月間データ量(概算) | 月額クエリ費用目安 | 推奨対策 |

|---|---|---|---|

10万PV未満 | 1-5GB | 500円-2,500円 | 無料枠内で運用可能 |

100万PV | 50-100GB | 3,000円-6,000円 | クエリ最適化で半分に削減 |

1,000万PV | 500GB-1TB | 3万円-6万円 | パーティション設計必須 |

1億PV | 5TB以上 | 30万円以上 | 定額プランまたはサンプリング |

アドビの2024年デジタル分析コスト調査によると、BigQuery GA4連携を導入した企業の68%が「初月のクエリ費用が予算の2-3倍になった」と回答している。一方で、適切なクエリ最適化を行った企業では、3ヶ月後にコストを初月の40%まで削減できたという結果も出ている。

コスト削減のクエリ最適化

1. 日付範囲の制限

_TABLE_SUFFIXで処理対象を限定する。全期間クエリは避け、必要最小限の期間に絞る:

2. 必要なカラムのみ選択

SELECT *は全カラムを処理するため高コスト。必要なフィールドだけを明示的に選択する:

3. 事前フィルタの活用

JOINやUNNESTの前に、WHERE句で処理対象データを絞り込む:

よくある運用ミスと対策

ミス1:毎日の全データスキャンクエリ

ダッシュボード更新で毎回全期間データを処理してしまい、月額費用が数十万円に膨らむケース。増分処理や集計テーブルの活用で大幅にコスト削減できる。

ミス2:テストクエリでの大量処理

本番データでクエリテストを行い、意図せず大量データを処理してしまうミス。開発用にサンプルデータセットを作成し、LIMITを必ず付けてテストする。

ミス3:予算アラート未設定

Google Cloud Platformの予算アラート機能を設定せず、想定外のコストに気付くのが月末になるケース。日次・週次でのアラート設定が必須だ。

あわせて読みたい

BigQueryで分析したユーザー行動データを営業活動に活かすためのリード管理設計を解説。分析結果を実際のビジネス成果につなげる運用フローを設計できます。

外部データとの統合活用事例

BigQueryの真価は、GA4データ単体ではなく、広告配信データ・CRMデータ・在庫データなど複数のデータソースを統合した分析にある。顧客のフルジャーニーを可視化し、チャネル横断での最適化が可能になる。

特にECサイトでは、Web行動データと購買履歴・在庫状況を組み合わせることで、売り切れ前の在庫アラートや、購買確度の高いユーザーセグメントでの広告配信最適化などが実現できる。

Google広告データとの統合分析

Google Ads Data Transfer Serviceを使用してGoogle広告の配信データをBigQueryに取り込み、GA4のコンバージョンデータと結合する。これによりLTVを加味した真のROASや、クリエイティブ別の顧客質の違いが見えてくる:

CRMデータとの顧客分析

Cloud StorageまたはCloud SQLに格納したCRMデータと、GA4のuser_idを紐付けることで、オンライン行動と購買履歴を統合した顧客分析が可能になる。リピート購入の予測モデルやカスタマーセグメンテーションに活用できる:

顧客ライフタイムバリュー(LTV)の精密計算:Web行動パターンと実際の購買金額・頻度を組み合わせ

チャーン予測:サイト訪問頻度の変化と過去の離反パターンから早期アラート

クロスセル・アップセル機会の発見:商品カテゴリ別の行動データと購買履歴の相関分析

在庫データとの運用最適化

リアルタイムの在庫情報とGA4の商品別PVデータを組み合わせ、売り切れリスクの高い商品への広告投資を自動調整する仕組みも構築できる。特にシーズン商材やトレンド商品を扱うECサイトで効果的だ。

2024年11月に発表されたZOZOの事例では、BigQueryでGA4データと在庫データを統合し、売り切れ前48時間での広告出稿停止により、無駄な広告費を月額200万円削減したという結果が公表されている。

よくある失敗パターンと回避策

BigQuery GA4連携の導入でよく見られる失敗パターンは、技術的な設定ミスよりも、運用フローやコスト管理の甘さに起因するケースが多い。事前に失敗パターンを把握し、対策を講じることが重要だ。

データガバナンスの欠如

失敗例:複数の部署がそれぞれ独自のクエリを作成し、同じデータを重複処理してコストが膨らむ。また、誤ったクエリで算出された数値がレポートに使われ、意思決定に悪影響を与える。

対策:

標準クエリテンプレートの作成と共有

定期集計テーブルの作成で重複処理を削減

クエリレビューフローの確立(本番実行前の承認プロセス)

BigQueryの権限管理でデータアクセス範囲を制限

リアルタイム性への過度な期待

失敗例:「BigQueryなら最新データがすぐ見られる」と期待したが、GA4の標準エクスポートは1日1回のため、当日の最新データが反映されない。急遽ストリーミングエクスポート(有料)に切り替えて月額コストが5倍になる。

対策:

ビジネス要件でリアルタイム性が本当に必要かを事前検証

GA4標準レポートとBigQuery分析の役割分担を明確化

月額500万PV未満であれば、まず無料の日次エクスポートから開始

リアルタイム分析が必要な指標のみストリーミング対象とする

クエリパフォーマンスの軽視

失敗例:SQLの知識が浅いまま複雑な分析クエリを作成し、実行時間が30分以上かかる非効率なクエリが日次バッチで動き続ける。結果として月額クエリ費用が予算の10倍になる。

対策:

BigQuery特有のベストプラクティス(パーティショニング・クラスタリング)の学習

クエリ実行前の処理データ量見積もりツールの活用

段階的な検証(小さなデータセットでテスト→本番適用)

定期的なクエリレビューとパフォーマンス改善

属人化とスキル格差

失敗例:BigQueryに詳しい担当者1名に依存し、その人が異動・退職した際に分析が完全にストップする。引き継ぎ資料もクエリのコメントも不十分で、復旧に3ヶ月かかる。

対策:

複数名でのスキル習得とナレッジ共有

クエリの可読性向上(コメント・変数名の統一)

分析フローのドキュメント化

外部研修やコンサルティングの活用

BigQuery GA4活用の将来性と発展

GA4とBigQueryの連携は、Google Cloud Platform上でのAI・機械学習サービスとの統合により、さらなる発展が期待されている。BigQuery MLを使った予測分析や、Looker Studioでの高度な可視化など、従来の Web分析の枠を超えた活用が可能だ。

機械学習による予測分析

BigQuery MLを活用すれば、SQLクエリだけでユーザーの離反予測やLTV予測モデルを構築できる。Pythonや専用のML環境を用意せずに、GA4データから直接予測モデルを作成し、マーケティング施策の精度向上に活用できる:

リアルタイム分析基盤の構築

Cloud Pub/SubとDataflowを組み合わせることで、GA4のMeasurement Protocolデータをリアルタイムで処理し、BigQueryに即座に反映する仕組みも構築できる。大規模なECサイトやメディアサイトでは、在庫切れアラートやトラフィック急増対応などに活用されている。

プライバシー規制への対応

GDPR・CCPA・日本の個人情報保護法の改正に伴い、ユーザー同意管理とデータ匿名化がより重要になっている。BigQueryでは、Differential Privacyやk-匿名化などの技術により、プライバシーを保護しながら有用なインサイトを抽出する機能が強化されている。

Googleの2025年戦略発表によると、2026年からはGA4のデータエクスポートでより詳細な同意ステータスが含まれるようになり、ユーザー同意レベルに応じた分析が可能になる予定だ。これにより、コンプライアンス要件を満たしながら、マーケティング効果を最大化する分析基盤が実現できる。

よくある質問

BigQuery GA4連携にかかる初期費用はどの程度ですか?

初期費用は基本的に無料で、Google Cloud Platformアカウント開設とGA4からの設定のみで開始できます。ただし、月間1TB以上のクエリ処理では従量課金が発生し、100万PVサイトで月額3,000-6,000円程度が目安となります。

GA4の生データはBigQueryでどこまで詳細に取得できますか?

ユーザーレベル・セッションレベル・イベントレベルまでの全データを取得でき、カスタムパラメータやeコマースの商品詳細まで含まれます。ただし、Googleシグナルによる集約やサンプリングされたデータは除外され、未加工の生データのみエクスポートされます。

過去データはいつまでさかのぼって分析できますか?

GA4標準では最大14ヶ月の保持期間ですが、BigQueryでは無制限にデータ保持できます。ただし、連携開始前のデータはエクスポートされないため、過去データの分析には連携設定日からの蓄積が必要です。

SQLの知識がない場合、BigQuery活用は難しいでしょうか?

基本的なSQLスキル習得は必要ですが、GA4のデータ構造は特殊なため、一般的なSQL知識だけでは不十分です。UNNESTオペレータや入れ子構造の理解が必要で、実務レベルまで約2-3ヶ月の学習期間を見込んでおくべきです。

BigQueryのクエリ処理が遅い場合の対処法はありますか?

処理速度改善には、日付範囲の制限・不要なカラムの除外・事前フィルタの活用が効果的です。また、頻繁に使用するクエリは集計済みテーブルとして保存し、差分更新することで処理時間を大幅短縮できます。

まとめ

BigQuery GA4連携は、従来のWeb解析の限界を超えた深い顧客理解と精密なマーケティング最適化を可能にする。設定自体は簡単だが、真価を発揮するには適切なデータ構造の理解と、ビジネス課題に応じたクエリ設計が不可欠だ。

成功のポイントは3つある。第一に、月間データ量とクエリ頻度を事前に見積もり、適切なコスト管理を行うこと。第二に、GA4の入れ子構造を理解し、効率的なデータ展開クエリを習得すること。第三に、他の社内データとの統合を視野に入れた分析基盤として設計することだ。

短期的にはGA4標準レポートの補完として活用し、中長期的には予測分析やリアルタイム最適化まで発展させることで、データドリブンマーケティングの実現につなげられる。月間100万PV超のサイトであれば、導入効果は確実にコストを上回る価値を生み出すはずだ。

© 2025 Cascade Inc, All Rights Reserved.

© 2025 Cascade Inc, All Rights Reserved.

© 2025 Cascade Inc, All Rights Reserved.