A/Bテストの設計|仮説検証を回すための基本と落とし穴

A/Bテストの設計|仮説検証を回すための基本と落とし穴

A/Bテストは最低1,000CV以上のサンプルサイズと95%信頼区間の設定により、統計的に信頼できる結果を得られる検証手法だ。ただし、テスト期間は最短でも2週間、できれば4週間確保し、曜日・時間帯の偏りを排除することが前提となる。

多くの企業がA/Bテストを実施しているものの、サンプルサイズ不足や検証期間の短縮により、誤った判断を下すケースが後を絶たない。本記事では、Google OptimizeからVWOまで実際のツールを使った設計手順と、統計的有意性を担保するための実務ポイントを整理する。

A/Bテストとは何か

A/Bテストは、オリジナル版(A)と変更版(B)を同時に異なるユーザーグループに表示し、どちらがより良い結果をもたらすかを統計的に検証する手法のことだ。

最も重要なのは「統計的有意性」の概念。これは結果が偶然ではなく、実際の改善効果によるものだと95%の確率で言えることを意味する。単純に「Bパターンの方がCVRが高かった」だけでは不十分で、その差が統計的に意味のある差なのかを判断する必要がある。

A/Bテストが適用される主な領域は以下の通り:

ランディングページのCVR改善(フォーム項目数、ボタンデザイン、見出し文言)

広告クリエイティブの効果検証(画像、コピー、CTA文言)

メール配信の開封率・クリック率向上(件名、送信時間、レイアウト)

ECサイトの購入率改善(商品ページレイアウト、価格表示方法、決済フロー)

アプリ内のユーザー体験改善(UIデザイン、機能配置、通知設定)

A/Bテストを始める前の準備

成功するA/Bテストの8割は事前準備で決まる。仮説設定、指標定義、サンプルサイズ計算の3点を整備してからテストを開始することが重要だ。

仮説設定の具体的な手順

仮説は「なぜそう考えるのか」の根拠と「どの程度の改善を期待するか」の数値目標をセットにして設定する。曖昧な予想では結果の解釈ができない。

良い仮説の例:「商品詳細ページの購入ボタンを緑から赤に変更すると、購入率が現在の2.3%から2.8%(+20%)に向上すると予想する。理由は、競合他社3社が赤いボタンを使用しており、ユーザーの慣習的な期待に合致するため。」

悪い仮説の例:「ボタンの色を変えれば何かしら改善するだろう。」「赤の方が目立つので良いはず。」

指標定義とセカンダリメトリクス

プライマリメトリクス(主要指標)は1つに絞る。CVR、売上、登録率など、最も重要な成果指標を選定する。

同時に、セカンダリメトリクス(副次指標)を2-3個設定する:

プライマリがCVRの場合:平均滞在時間、直帰率、クリック率

プライマリが売上の場合:購入単価、購入点数、リピート率

プライマリが登録率の場合:フォーム離脱率、入力時間、エラー発生率

A/Bテスト成功の6ステップ。仮説設定→テスト設計→実施→データ収集→統計分析→勝ちパターン実装の流れで、通常4-8週間のサイクルとなる。

サンプルサイズ計算の実務

統計的有意性を担保するために必要なサンプルサイズは、現在のCVR、期待する改善幅、信頼区間によって決まる。

現在のCVR | 期待改善幅 | 必要サンプルサイズ(各パターン) | 推奨テスト期間 |

|---|---|---|---|

1% | +20%(1.2%へ) | 15,686 CV | 6-8週間 |

2% | +15%(2.3%へ) | 21,852 CV | 4-6週間 |

5% | +10%(5.5%へ) | 12,435 CV | 2-4週間 |

10% | +8%(10.8%へ) | 8,921 CV | 2-3週間 |

月間CV数が1,000未満のサイトでは、意味のあるA/Bテストの実施は困難だ。この場合は、定性的なユーザビリティテストやヒートマップ分析を優先すべきである。

あわせて読みたい

KGIとKPIの違いと設計手順|広告運用に落とし込む組み立て

A/Bテストの成果指標設計に欠かせないKPI設定の具体的な手順と、広告運用との連携方法を解説。

A/Bテストツールの選定と設定

予算と技術要件に応じてツールを選定し、適切な設定を行うことがテストの精度を左右する。無料ツールでも統計的に有効なテストは可能だが、機能制限を理解して使う必要がある。

主要ツールの比較と選定基準

ツール | 月額料金 | 同時テスト数 | 技術要件 | 適用企業規模 |

|---|---|---|---|---|

Google Optimize(2023年9月終了) | 無料 | 5個まで | GTM連携 | 中小企業向け |

VWO | $199-$999 | 制限なし | JS埋め込み | 中〜大企業向け |

Optimizely | 要相談($50,000〜) | 制限なし | SDK/API | 大企業・エンタープライズ |

Adobe Target | 要相談 | 制限なし | Adobe Experience Cloud | 大企業向け |

月間CV数別の推奨ツール選択

月間CV数500未満の場合、有料ツールへの投資よりもLPOやUX改善に予算を振り向けるほうが効率的だ。一方、月間CV数5,000以上であれば、複数の同時テスト実行により改善サイクルを高速化できる。

月間CV数1,000-5,000の中間層では、VWOのスターターハン(月額$199)が費用対効果の観点から最適解となることが多い。

トラフィック分散の設定

基本は50:50の分散だが、リスクを抑えたい場合は90:10や80:20の設定も可能。ただし、少数派のサンプルサイズ確保に時間がかかる点に注意。

ECサイトの売上への影響を懸念する場合:

新規ユーザーのみを対象にする

特定の流入経路(オーガニック検索、有料広告)に限定する

特定の曜日・時間帯のみでテストする

テスト実行中の監視とデータ収集

テスト期間中は毎日の結果確認は避け、週1回程度のモニタリングに留める。頻繁なチェックは「p-hacking」(都合の良い結果が出るまでテストを続ける)の原因となり、統計的有意性を歪める。

監視すべき指標

テスト実行中に注意深く監視すべきは結果よりもプロセス指標だ:

トラフィック分散比率(設定通りに分かれているか)

セッション数の増減(外部要因による変動はないか)

技術的エラー(JSエラー、ページ読み込み遅延)

サンプルサイズの蓄積ペース(予定期間内に到達するか)

テスト中断の判断基準

以下の場合はテストを中断し、設定を見直す:

CVRが50%以上悪化し、3日間継続した場合

技術的な問題でデータに欠損が生じた場合

外部要因(キャンペーン、季節イベント)で通常とは異なるトラフィック増減が発生した場合

サンプルサイズの蓄積が予定の50%以下に留まった場合

特に注意すべきは「勝ちパターンが見えたから早期終了」の判断だ。統計的有意性は事前に設定したサンプルサイズに到達してから判定しなければ意味がない。

結果分析と統計的有意性の判定

A/Bテストの結果判定には統計的有意性(p値<0.05)と実践的有意性(効果サイズ)の両方を考慮する必要がある。数値の改善が見られても、ビジネスインパクトが小さければ実装する価値はない。

p値の正しい解釈

p値は「この結果が偶然起こる確率」を示す。p<0.05は「5%以下の確率でしか偶然は起こらない=95%の確信で効果がある」という意味だ。

ただし、p値だけでは実際のビジネス価値は判断できない。CVRが2.0%から2.1%に改善してp<0.05だったとしても、月間売上への影響が1万円程度なら、実装コストを考慮すると見送りが妥当な場合が多い。

信頼区間による効果範囲の把握

95%信頼区間により、実際の改善幅の範囲を推定できる。例えば「CVRの改善幅は2.1%〜8.7%の範囲にある(95%の確率)」といった解釈が可能だ。

信頼区間の下限がビジネス的に意味のある改善値を上回っている場合、実装を推奨する。下限が小さすぎる場合は、サンプルサイズを増やしてテストを延長するかを検討。

判定結果 | p値 | 信頼区間 | 推奨アクション |

|---|---|---|---|

明確な勝ち | p < 0.01 | 下限 > 5%改善 | 即座に実装 |

有意だが効果小 | p < 0.05 | 下限 < 3%改善 | コスト考慮して判断 |

有意性なし | p > 0.05 | 0を含む | テスト延長orパターン変更 |

明確な負け | p < 0.05 | 上限 < -3% | オリジナル継続 |

セカンダリメトリクスの分析

プライマリメトリクスで勝ちパターンが確定しても、セカンダリメトリクスの悪化がないかを確認する。CVRが向上してもLTVが下がる、購入単価が下がる等の副作用がある場合は慎重に判断。

特に重要なのは以下の指標:

サイト全体の直帰率(改善箇所以外への影響)

リピート購入率(短期的な改善が長期的な顧客価値を損なっていないか)

平均注文価格(CVR向上と引き換えに客単価が下がっていないか)

カスタマーサポート問い合わせ数(ユーザビリティの悪化がないか)

あわせて読みたい

LTV(顧客生涯価値)の計算式と改善|広告運用に活かす考え方

A/Bテスト結果の長期的な価値判定に不可欠なLTV分析の具体的な計算方法と改善アプローチ。

よくある失敗パターンと回避方法

A/Bテストの90%以上が何らかの設計ミスや実行エラーにより、信頼できない結果に終わる。以下の失敗パターンを事前に把握し、チェックリストとして活用することが重要だ。

サンプルサイズ不足による誤判定

最も多い失敗は、統計的に意味のないサンプルサイズでテストを終了すること。「1週間で結果を出したい」という要望により、数百CVで判定を下すケースが頻発している。

回避方法:

事前にサンプルサイズ計算を行い、到達時期を明確にする

「最短でも2週間、推奨4週間」のテスト期間を確保する

月間CV数が500未満の場合は、A/Bテスト以外の改善手法を検討する

同時期の複数変更による交互作用

A/Bテスト実行中に別の施策(広告キャンペーン、価格変更、新機能リリース)を同時実施し、どの要因が結果に影響したかわからなくなる失敗。

回避方法:

テスト期間中は他の大きな変更を凍結する

やむを得ず変更する場合は、その影響を分析に加味する

季節要因(年末年始、決算期等)を避けてテスト時期を設定する

ページ速度やUXの悪化

テストパターンでJavaScriptの読み込みが増加し、ページ表示速度が低下。結果としてCVRが悪化しているのに、デザイン変更が原因だと誤判定するケース。

回避方法:

テスト開始前後でページ読み込み時間を測定

モバイル環境での表示確認を必須とする

0.5秒以上の読み込み遅延が発生する場合は設定を見直す

統計的多重性による偽陽性

同時に5個のA/Bテストを実行した場合、そのうち1個は偶然p<0.05になる確率が高い。多重比較補正を行わずに全てを有意と判定する失敗。

回避方法:

同時実行するテスト数は3個以下に限定

ボンフェローニ補正等で有意水準を調整する

プライマリメトリクス以外の指標で有意性判定を行わない

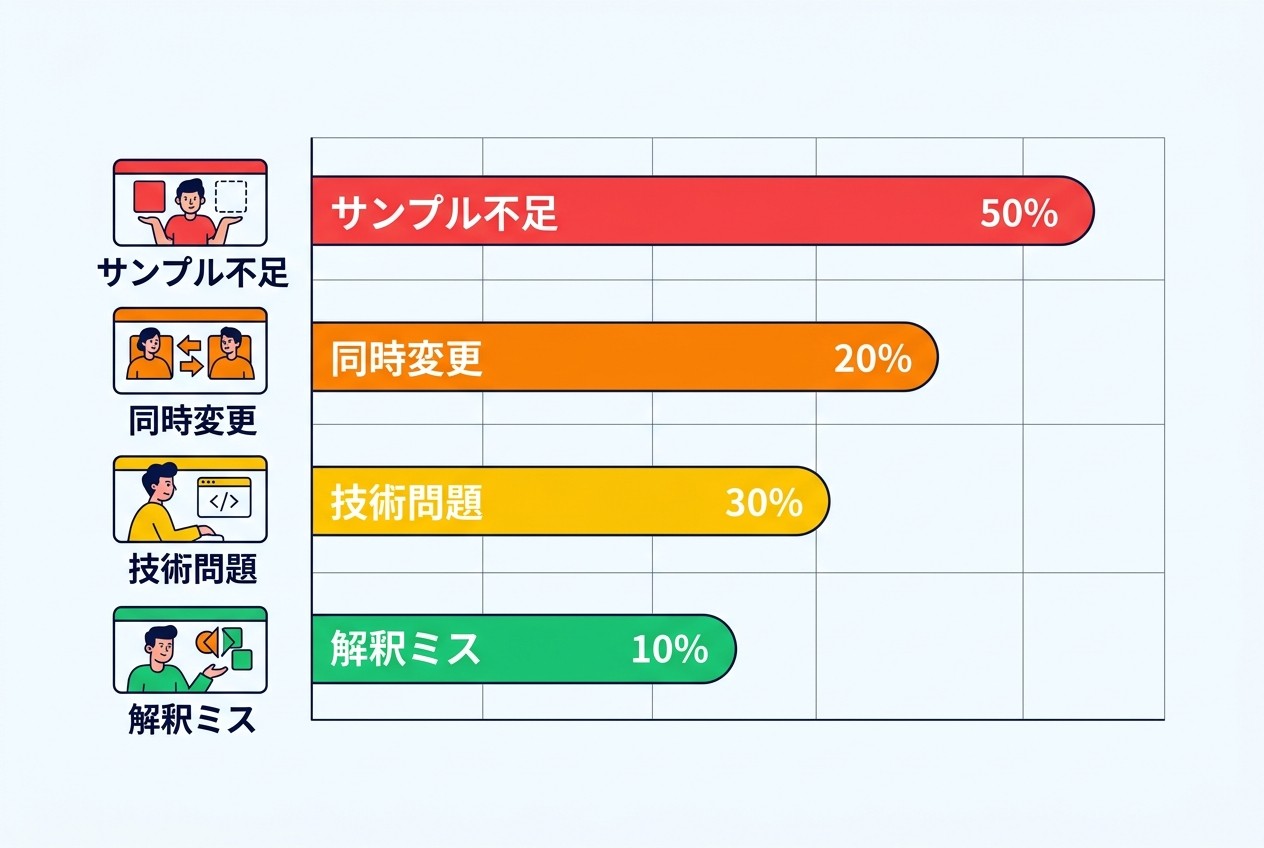

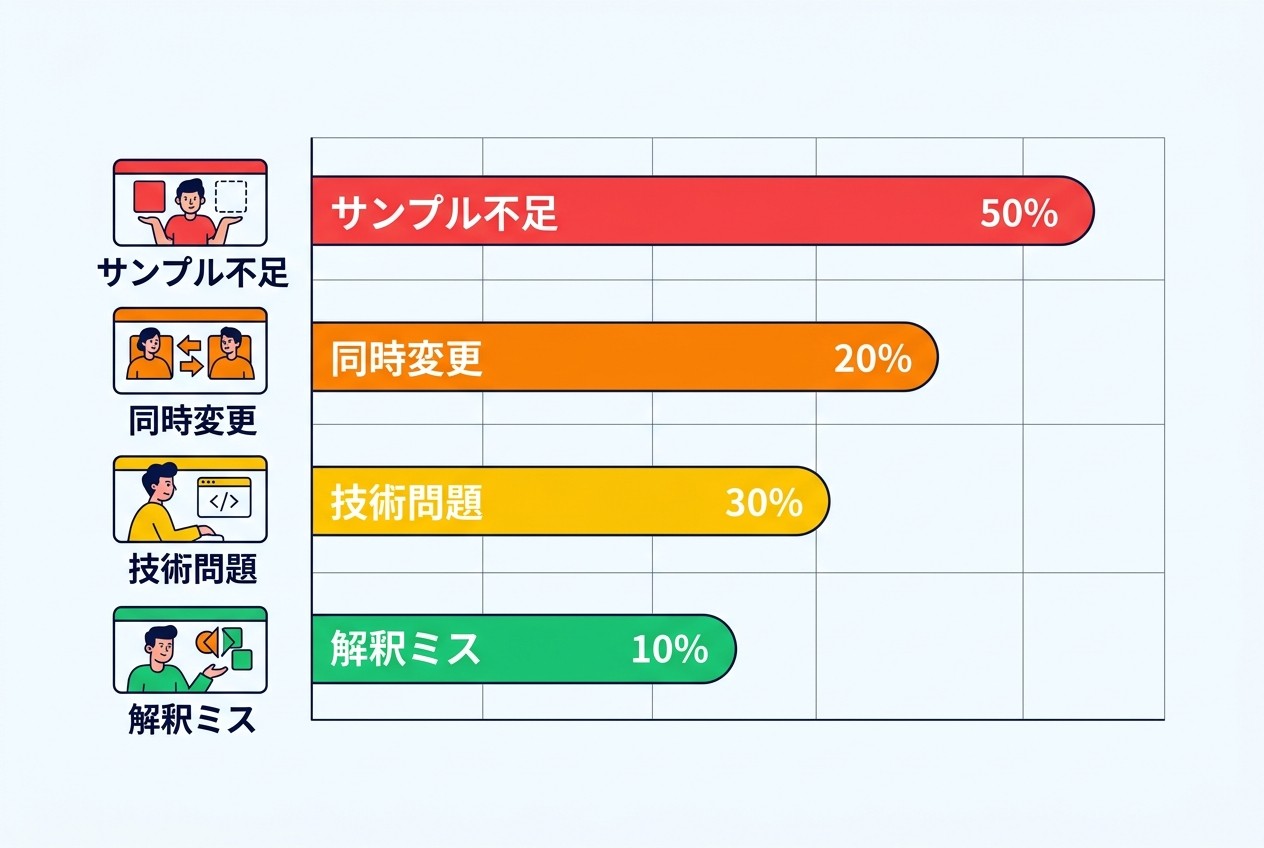

A/Bテスト失敗の主要因。サンプルサイズ不足が全体の45%を占め、同時期の他施策との混在が23%と続く。技術的な問題とデータ解釈のミスがそれぞれ16%ずつとなっている。

勝ちパターンの実装と次のテスト設計

統計的有意性が確認できた改善案は段階的に実装し、効果の持続性を監視する必要がある。テスト環境と本番環境の違いにより、実装後に効果が薄れるケースがあるためだ。

段階的な実装手順

全トラフィックへの一斉適用ではなく、段階的に適用範囲を拡大する:

20%のトラフィックで2週間実装し、効果の再現性を確認

問題がなければ50%まで拡大し、さらに1週間監視

最終的に100%のトラフィックに適用

この段階的実装により、万一の負の影響を最小限に抑えられる。特にECサイトの決済フロー変更など、売上への影響が大きい改修では必須の手順だ。

効果の持続性監視

実装から4週間は週次で主要指標をモニタリングし、効果が維持されているかを確認。novelty effect(新しいもの効果)により、実装直後は効果が高く出るが、徐々に薄れることがある。

監視すべき指標:

実装前後の同期間比較(昨年同月、3ヶ月前等)

新規ユーザーとリピートユーザーの反応差

デバイス別(PC・SP・タブレット)の効果差

流入経路別(オーガニック・広告・SNS等)の効果差

次のテスト優先度の決定

成功したA/Bテストの結果から、次にテストすべき要素の優先度を決める。改善効果の大きかった要素周辺の微調整よりも、まったく異なる要素のテストの方が大きな改善を生む可能性が高い。

優先度付けの観点:

インパクトの大きさ(売上・CV数への影響予測)

実装の容易さ(開発工数、リスクの大きさ)

学習価値(今後の施策に活かせる知見が得られるか)

競合差別化(独自性のある改善になるか)

月間CV数5,000以上の企業では、3つのA/Bテストを並行実行し、常に改善サイクルを回す体制を構築できる。この場合、ページ全体を3つのエリア(ヘッダー、メイン、フッター)に分けて同時テストするか、異なるページ(LP・商品ページ・決済ページ)で分散実行する。

よくある質問

A/Bテストに必要な最小サンプル数はどれくらいですか?

統計的に信頼できる結果を得るには、各パターンで最低1,000CVは必要だ。現在のCVRと期待改善幅により変動するが、CVRが低いほど、期待改善幅が小さいほど多くのサンプルが必要になる。月間CV数が500未満の場合、A/Bテスト以外の改善手法を優先すべきである。

テスト期間はどのくらい設定すればよいですか?

最短でも2週間、推奨は4週間以上だ。曜日や時間帯による偏りを排除するため、少なくとも2週間分のデータサイクルが必要。季節要因やキャンペーンの影響を受けやすい業界では、さらに長期間の設定を検討する。

複数の要素を同時にテストしても問題ありませんか?

同一ページ内の複数要素を同時に変更すると、どの要素が効果をもたらしたか特定できなくなる。1回のテストでは1つの要素のみを変更することが原則。ただし、完全に独立した要素(ヘッダーとフッター等)であれば同時テスト可能。

p値が0.05を下回れば必ず実装すべきですか?

統計的有意性だけでなく、実践的有意性も考慮する必要がある。改善率が統計的に有意でも、ビジネスインパクトが小さければ実装コストと見合わない場合がある。改善による売上増加額と実装・運用コストを比較して判断すべきだ。

Google Optimize終了後の代替ツールはどれがおすすめですか?

予算と技術要件により選択肢は変わる。月間CV数1,000-5,000の中小企業にはVWOのスタータープラン(月額$199)がコストパフォーマンスに優れている。月間CV数5,000以上の企業では、OptimizelyやAdobe Targetを検討すべきだ。

まとめ

A/Bテストの成功は事前設計で8割が決まる。仮説設定、サンプルサイズ計算、適切な指標選定を行い、統計的有意性を担保できる環境を整えてからテストを開始することが重要だ。

特に重要なポイント:

各パターン最低1,000CV、テスト期間最低2週間を確保する

プライマリメトリクスは1つに絞り、セカンダリメトリクスで副作用を監視する

統計的有意性(p<0.05)と実践的有意性(ビジネスインパクト)の両方で判定する

勝ちパターンは段階的に実装し、効果の持続性を監視する

月間CV数が不足する場合は、A/Bテストよりもユーザビリティテストや定性調査を優先し、改善の仮説を強化してからテストに臨むことが効率的である。

UTMパラメータの設計やコンテンツマーケティング戦略と組み合わせることで、より包括的な改善サイクルを構築できる。

A/Bテストは最低1,000CV以上のサンプルサイズと95%信頼区間の設定により、統計的に信頼できる結果を得られる検証手法だ。ただし、テスト期間は最短でも2週間、できれば4週間確保し、曜日・時間帯の偏りを排除することが前提となる。

多くの企業がA/Bテストを実施しているものの、サンプルサイズ不足や検証期間の短縮により、誤った判断を下すケースが後を絶たない。本記事では、Google OptimizeからVWOまで実際のツールを使った設計手順と、統計的有意性を担保するための実務ポイントを整理する。

A/Bテストとは何か

A/Bテストは、オリジナル版(A)と変更版(B)を同時に異なるユーザーグループに表示し、どちらがより良い結果をもたらすかを統計的に検証する手法のことだ。

最も重要なのは「統計的有意性」の概念。これは結果が偶然ではなく、実際の改善効果によるものだと95%の確率で言えることを意味する。単純に「Bパターンの方がCVRが高かった」だけでは不十分で、その差が統計的に意味のある差なのかを判断する必要がある。

A/Bテストが適用される主な領域は以下の通り:

ランディングページのCVR改善(フォーム項目数、ボタンデザイン、見出し文言)

広告クリエイティブの効果検証(画像、コピー、CTA文言)

メール配信の開封率・クリック率向上(件名、送信時間、レイアウト)

ECサイトの購入率改善(商品ページレイアウト、価格表示方法、決済フロー)

アプリ内のユーザー体験改善(UIデザイン、機能配置、通知設定)

A/Bテストを始める前の準備

成功するA/Bテストの8割は事前準備で決まる。仮説設定、指標定義、サンプルサイズ計算の3点を整備してからテストを開始することが重要だ。

仮説設定の具体的な手順

仮説は「なぜそう考えるのか」の根拠と「どの程度の改善を期待するか」の数値目標をセットにして設定する。曖昧な予想では結果の解釈ができない。

良い仮説の例:「商品詳細ページの購入ボタンを緑から赤に変更すると、購入率が現在の2.3%から2.8%(+20%)に向上すると予想する。理由は、競合他社3社が赤いボタンを使用しており、ユーザーの慣習的な期待に合致するため。」

悪い仮説の例:「ボタンの色を変えれば何かしら改善するだろう。」「赤の方が目立つので良いはず。」

指標定義とセカンダリメトリクス

プライマリメトリクス(主要指標)は1つに絞る。CVR、売上、登録率など、最も重要な成果指標を選定する。

同時に、セカンダリメトリクス(副次指標)を2-3個設定する:

プライマリがCVRの場合:平均滞在時間、直帰率、クリック率

プライマリが売上の場合:購入単価、購入点数、リピート率

プライマリが登録率の場合:フォーム離脱率、入力時間、エラー発生率

A/Bテスト成功の6ステップ。仮説設定→テスト設計→実施→データ収集→統計分析→勝ちパターン実装の流れで、通常4-8週間のサイクルとなる。

サンプルサイズ計算の実務

統計的有意性を担保するために必要なサンプルサイズは、現在のCVR、期待する改善幅、信頼区間によって決まる。

現在のCVR | 期待改善幅 | 必要サンプルサイズ(各パターン) | 推奨テスト期間 |

|---|---|---|---|

1% | +20%(1.2%へ) | 15,686 CV | 6-8週間 |

2% | +15%(2.3%へ) | 21,852 CV | 4-6週間 |

5% | +10%(5.5%へ) | 12,435 CV | 2-4週間 |

10% | +8%(10.8%へ) | 8,921 CV | 2-3週間 |

月間CV数が1,000未満のサイトでは、意味のあるA/Bテストの実施は困難だ。この場合は、定性的なユーザビリティテストやヒートマップ分析を優先すべきである。

あわせて読みたい

KGIとKPIの違いと設計手順|広告運用に落とし込む組み立て

A/Bテストの成果指標設計に欠かせないKPI設定の具体的な手順と、広告運用との連携方法を解説。

A/Bテストツールの選定と設定

予算と技術要件に応じてツールを選定し、適切な設定を行うことがテストの精度を左右する。無料ツールでも統計的に有効なテストは可能だが、機能制限を理解して使う必要がある。

主要ツールの比較と選定基準

ツール | 月額料金 | 同時テスト数 | 技術要件 | 適用企業規模 |

|---|---|---|---|---|

Google Optimize(2023年9月終了) | 無料 | 5個まで | GTM連携 | 中小企業向け |

VWO | $199-$999 | 制限なし | JS埋め込み | 中〜大企業向け |

Optimizely | 要相談($50,000〜) | 制限なし | SDK/API | 大企業・エンタープライズ |

Adobe Target | 要相談 | 制限なし | Adobe Experience Cloud | 大企業向け |

月間CV数別の推奨ツール選択

月間CV数500未満の場合、有料ツールへの投資よりもLPOやUX改善に予算を振り向けるほうが効率的だ。一方、月間CV数5,000以上であれば、複数の同時テスト実行により改善サイクルを高速化できる。

月間CV数1,000-5,000の中間層では、VWOのスターターハン(月額$199)が費用対効果の観点から最適解となることが多い。

トラフィック分散の設定

基本は50:50の分散だが、リスクを抑えたい場合は90:10や80:20の設定も可能。ただし、少数派のサンプルサイズ確保に時間がかかる点に注意。

ECサイトの売上への影響を懸念する場合:

新規ユーザーのみを対象にする

特定の流入経路(オーガニック検索、有料広告)に限定する

特定の曜日・時間帯のみでテストする

テスト実行中の監視とデータ収集

テスト期間中は毎日の結果確認は避け、週1回程度のモニタリングに留める。頻繁なチェックは「p-hacking」(都合の良い結果が出るまでテストを続ける)の原因となり、統計的有意性を歪める。

監視すべき指標

テスト実行中に注意深く監視すべきは結果よりもプロセス指標だ:

トラフィック分散比率(設定通りに分かれているか)

セッション数の増減(外部要因による変動はないか)

技術的エラー(JSエラー、ページ読み込み遅延)

サンプルサイズの蓄積ペース(予定期間内に到達するか)

テスト中断の判断基準

以下の場合はテストを中断し、設定を見直す:

CVRが50%以上悪化し、3日間継続した場合

技術的な問題でデータに欠損が生じた場合

外部要因(キャンペーン、季節イベント)で通常とは異なるトラフィック増減が発生した場合

サンプルサイズの蓄積が予定の50%以下に留まった場合

特に注意すべきは「勝ちパターンが見えたから早期終了」の判断だ。統計的有意性は事前に設定したサンプルサイズに到達してから判定しなければ意味がない。

結果分析と統計的有意性の判定

A/Bテストの結果判定には統計的有意性(p値<0.05)と実践的有意性(効果サイズ)の両方を考慮する必要がある。数値の改善が見られても、ビジネスインパクトが小さければ実装する価値はない。

p値の正しい解釈

p値は「この結果が偶然起こる確率」を示す。p<0.05は「5%以下の確率でしか偶然は起こらない=95%の確信で効果がある」という意味だ。

ただし、p値だけでは実際のビジネス価値は判断できない。CVRが2.0%から2.1%に改善してp<0.05だったとしても、月間売上への影響が1万円程度なら、実装コストを考慮すると見送りが妥当な場合が多い。

信頼区間による効果範囲の把握

95%信頼区間により、実際の改善幅の範囲を推定できる。例えば「CVRの改善幅は2.1%〜8.7%の範囲にある(95%の確率)」といった解釈が可能だ。

信頼区間の下限がビジネス的に意味のある改善値を上回っている場合、実装を推奨する。下限が小さすぎる場合は、サンプルサイズを増やしてテストを延長するかを検討。

判定結果 | p値 | 信頼区間 | 推奨アクション |

|---|---|---|---|

明確な勝ち | p < 0.01 | 下限 > 5%改善 | 即座に実装 |

有意だが効果小 | p < 0.05 | 下限 < 3%改善 | コスト考慮して判断 |

有意性なし | p > 0.05 | 0を含む | テスト延長orパターン変更 |

明確な負け | p < 0.05 | 上限 < -3% | オリジナル継続 |

セカンダリメトリクスの分析

プライマリメトリクスで勝ちパターンが確定しても、セカンダリメトリクスの悪化がないかを確認する。CVRが向上してもLTVが下がる、購入単価が下がる等の副作用がある場合は慎重に判断。

特に重要なのは以下の指標:

サイト全体の直帰率(改善箇所以外への影響)

リピート購入率(短期的な改善が長期的な顧客価値を損なっていないか)

平均注文価格(CVR向上と引き換えに客単価が下がっていないか)

カスタマーサポート問い合わせ数(ユーザビリティの悪化がないか)

あわせて読みたい

LTV(顧客生涯価値)の計算式と改善|広告運用に活かす考え方

A/Bテスト結果の長期的な価値判定に不可欠なLTV分析の具体的な計算方法と改善アプローチ。

よくある失敗パターンと回避方法

A/Bテストの90%以上が何らかの設計ミスや実行エラーにより、信頼できない結果に終わる。以下の失敗パターンを事前に把握し、チェックリストとして活用することが重要だ。

サンプルサイズ不足による誤判定

最も多い失敗は、統計的に意味のないサンプルサイズでテストを終了すること。「1週間で結果を出したい」という要望により、数百CVで判定を下すケースが頻発している。

回避方法:

事前にサンプルサイズ計算を行い、到達時期を明確にする

「最短でも2週間、推奨4週間」のテスト期間を確保する

月間CV数が500未満の場合は、A/Bテスト以外の改善手法を検討する

同時期の複数変更による交互作用

A/Bテスト実行中に別の施策(広告キャンペーン、価格変更、新機能リリース)を同時実施し、どの要因が結果に影響したかわからなくなる失敗。

回避方法:

テスト期間中は他の大きな変更を凍結する

やむを得ず変更する場合は、その影響を分析に加味する

季節要因(年末年始、決算期等)を避けてテスト時期を設定する

ページ速度やUXの悪化

テストパターンでJavaScriptの読み込みが増加し、ページ表示速度が低下。結果としてCVRが悪化しているのに、デザイン変更が原因だと誤判定するケース。

回避方法:

テスト開始前後でページ読み込み時間を測定

モバイル環境での表示確認を必須とする

0.5秒以上の読み込み遅延が発生する場合は設定を見直す

統計的多重性による偽陽性

同時に5個のA/Bテストを実行した場合、そのうち1個は偶然p<0.05になる確率が高い。多重比較補正を行わずに全てを有意と判定する失敗。

回避方法:

同時実行するテスト数は3個以下に限定

ボンフェローニ補正等で有意水準を調整する

プライマリメトリクス以外の指標で有意性判定を行わない

A/Bテスト失敗の主要因。サンプルサイズ不足が全体の45%を占め、同時期の他施策との混在が23%と続く。技術的な問題とデータ解釈のミスがそれぞれ16%ずつとなっている。

勝ちパターンの実装と次のテスト設計

統計的有意性が確認できた改善案は段階的に実装し、効果の持続性を監視する必要がある。テスト環境と本番環境の違いにより、実装後に効果が薄れるケースがあるためだ。

段階的な実装手順

全トラフィックへの一斉適用ではなく、段階的に適用範囲を拡大する:

20%のトラフィックで2週間実装し、効果の再現性を確認

問題がなければ50%まで拡大し、さらに1週間監視

最終的に100%のトラフィックに適用

この段階的実装により、万一の負の影響を最小限に抑えられる。特にECサイトの決済フロー変更など、売上への影響が大きい改修では必須の手順だ。

効果の持続性監視

実装から4週間は週次で主要指標をモニタリングし、効果が維持されているかを確認。novelty effect(新しいもの効果)により、実装直後は効果が高く出るが、徐々に薄れることがある。

監視すべき指標:

実装前後の同期間比較(昨年同月、3ヶ月前等)

新規ユーザーとリピートユーザーの反応差

デバイス別(PC・SP・タブレット)の効果差

流入経路別(オーガニック・広告・SNS等)の効果差

次のテスト優先度の決定

成功したA/Bテストの結果から、次にテストすべき要素の優先度を決める。改善効果の大きかった要素周辺の微調整よりも、まったく異なる要素のテストの方が大きな改善を生む可能性が高い。

優先度付けの観点:

インパクトの大きさ(売上・CV数への影響予測)

実装の容易さ(開発工数、リスクの大きさ)

学習価値(今後の施策に活かせる知見が得られるか)

競合差別化(独自性のある改善になるか)

月間CV数5,000以上の企業では、3つのA/Bテストを並行実行し、常に改善サイクルを回す体制を構築できる。この場合、ページ全体を3つのエリア(ヘッダー、メイン、フッター)に分けて同時テストするか、異なるページ(LP・商品ページ・決済ページ)で分散実行する。

よくある質問

A/Bテストに必要な最小サンプル数はどれくらいですか?

統計的に信頼できる結果を得るには、各パターンで最低1,000CVは必要だ。現在のCVRと期待改善幅により変動するが、CVRが低いほど、期待改善幅が小さいほど多くのサンプルが必要になる。月間CV数が500未満の場合、A/Bテスト以外の改善手法を優先すべきである。

テスト期間はどのくらい設定すればよいですか?

最短でも2週間、推奨は4週間以上だ。曜日や時間帯による偏りを排除するため、少なくとも2週間分のデータサイクルが必要。季節要因やキャンペーンの影響を受けやすい業界では、さらに長期間の設定を検討する。

複数の要素を同時にテストしても問題ありませんか?

同一ページ内の複数要素を同時に変更すると、どの要素が効果をもたらしたか特定できなくなる。1回のテストでは1つの要素のみを変更することが原則。ただし、完全に独立した要素(ヘッダーとフッター等)であれば同時テスト可能。

p値が0.05を下回れば必ず実装すべきですか?

統計的有意性だけでなく、実践的有意性も考慮する必要がある。改善率が統計的に有意でも、ビジネスインパクトが小さければ実装コストと見合わない場合がある。改善による売上増加額と実装・運用コストを比較して判断すべきだ。

Google Optimize終了後の代替ツールはどれがおすすめですか?

予算と技術要件により選択肢は変わる。月間CV数1,000-5,000の中小企業にはVWOのスタータープラン(月額$199)がコストパフォーマンスに優れている。月間CV数5,000以上の企業では、OptimizelyやAdobe Targetを検討すべきだ。

まとめ

A/Bテストの成功は事前設計で8割が決まる。仮説設定、サンプルサイズ計算、適切な指標選定を行い、統計的有意性を担保できる環境を整えてからテストを開始することが重要だ。

特に重要なポイント:

各パターン最低1,000CV、テスト期間最低2週間を確保する

プライマリメトリクスは1つに絞り、セカンダリメトリクスで副作用を監視する

統計的有意性(p<0.05)と実践的有意性(ビジネスインパクト)の両方で判定する

勝ちパターンは段階的に実装し、効果の持続性を監視する

月間CV数が不足する場合は、A/Bテストよりもユーザビリティテストや定性調査を優先し、改善の仮説を強化してからテストに臨むことが効率的である。

UTMパラメータの設計やコンテンツマーケティング戦略と組み合わせることで、より包括的な改善サイクルを構築できる。

© 2025 Cascade Inc, All Rights Reserved.

© 2025 Cascade Inc, All Rights Reserved.

© 2025 Cascade Inc, All Rights Reserved.